本記事では、Cognition AIがなぜ現在のマルチエージェントシステムに懐疑的なのか、その根拠となる「原則」と具体的な「課題」を深掘りします。LLMエージェントの基本的な概念から、その「脆さ」の根源にある分散意思決定とコンテキスト共有の課題、そして未来に向けた展望までを、多角的な情報源を参照しながら詳細に解説します。

2. LLMエージェントとは何か?基本を理解する

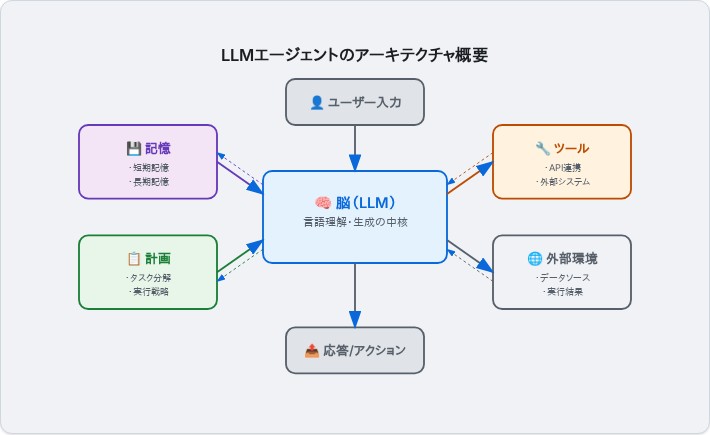

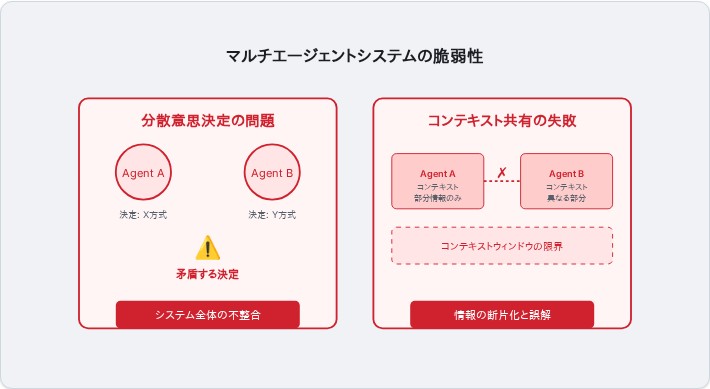

LLMエージェントとは、大規模言語モデル(LLM)を中核に据え、外部ツールや記憶機能を活用することで、自律的にタスクを実行し、意思決定を行い、ユーザーや他のシステムと対話するAIシステムを指します。これらのエージェントは、膨大なテキストデータで訓練されたLLMの言語理解・生成能力を基盤とし、人間のような言語関連タスクを遂行することで、意思決定プロセスやユーザーインタラクションの質を高めるように設計されています。

LLMエージェントの主要コンポーネント

LLMエージェントは、その自律的な振る舞いを可能にするために、主に以下の四つの主要コンポーネントで構成されています:

LLMエージェントのアーキテクチャ

アーキテクチャの重要な特徴

LLMエージェントの各コンポーネントは、それぞれが特定の機能を持つモジュールとして設計されており、これは伝統的なソフトウェア開発におけるマイクロサービスアーキテクチャや、分散システムにおける専門エージェントの概念と非常に類似しています。

この内部的な「分散」の側面は、単一エージェント内ですら複雑な調整が必要であることを意味します。この複雑性は、複数のエージェントが連携する際の「分散意思決定」や「コンテキスト共有」の課題の根源となります。

3. Cognition AIが提唱する「マルチエージェントを構築しない」原則

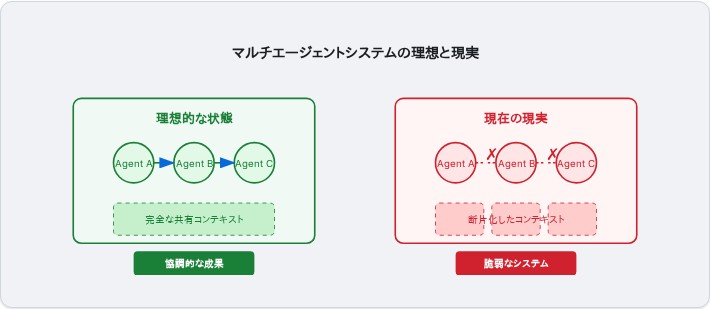

Cognition AIが提唱する「マルチエージェントを構築しない」という原則の核心は、エージェントの行動がシステム全体の一貫した意思決定のコンテキストによって情報提供されるべきであるという考え方にあります。これは、システム全体の信頼性を確保するための基盤となる重要な指針です。

核心原則:完全なコンテキスト共有

理想的な状態

エージェントが取るすべての行動は、システム内の他の部分が行ったすべての関連する意思決定によって常に情報提供されるべきです。

しかし、現実には、現在の技術的制約、特に「コンテキストウィンドウ」の限界と実用的なトレードオフにより、この理想を常に実現することは困難です。

コンテキストウィンドウの制約

コンテキストウィンドウとは技術的制約

LLMの「コンテキストウィンドウ」とは、モデルが一度に考慮または「記憶」できるテキストの量(トークン単位)を指します。これはLLMの「ワーキングメモリ」に相当し、どれだけ長い会話を詳細を忘れずに続けられるか、またはどれだけ大きなドキュメントやコードを一度に処理できるかを決定します。

原則の具体的な適用例

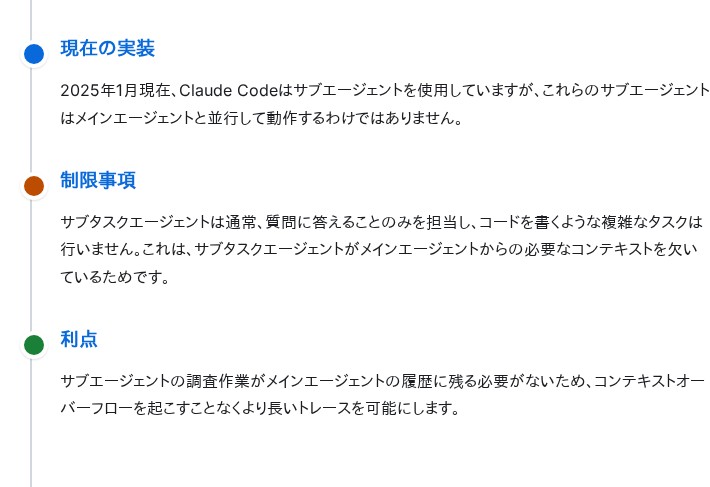

1. Claude Codeのサブエージェント戦略

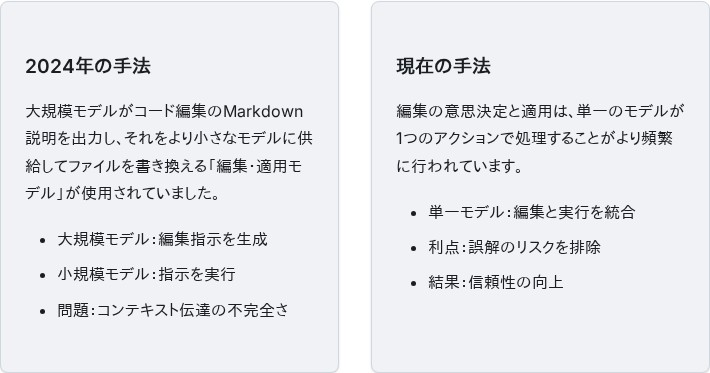

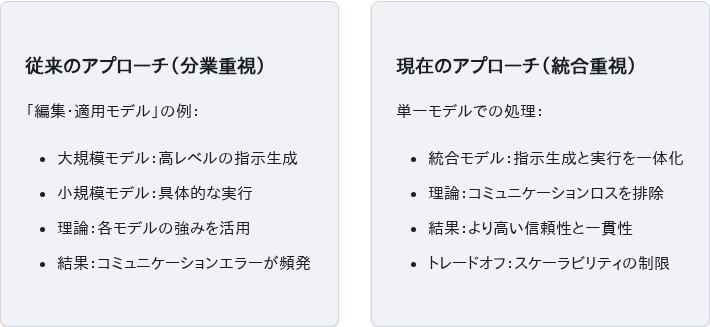

2. 「編集・適用モデル」の進化

重要な洞察

Claude Codeのサブエージェント戦略や、「編集・適用モデル」から単一モデルへの移行は、複雑なシステムにおいて「シンプルさ」と「単一責任の原則」がいかに重要であるかを強調しています。

これは、分業の理想よりも、現時点での信頼性と管理の容易さを優先する現実的なアプローチと言えるでしょう。

4. マルチエージェントシステムの現状と課題

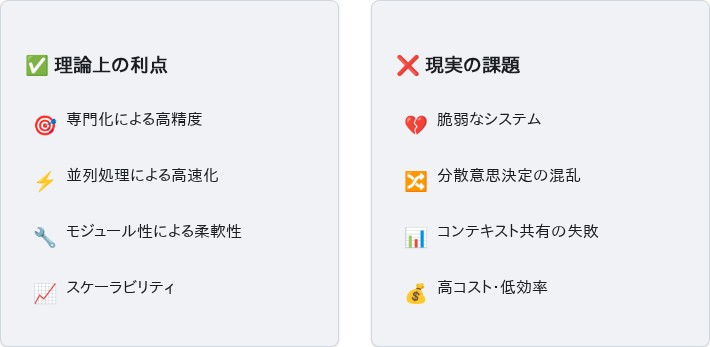

ChatGPTの登場以来、複数のエージェントが連携して目標を達成するというアイデアは、多くの研究者や開発者によって探求されてきました。これは、複雑なタスクを分業することで効率を高めるという魅力的なビジョンを提示します。

期待されるメリット

Cognition AIの評価

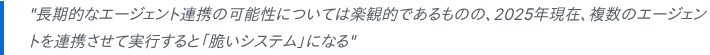

この脆さは、以下の2つの主要な要因に起因します:

具体的な失敗例:Flappy Birdクローンプロジェクト

実例:サブエージェントの協調失敗

Cognition AIが示した例では、Flappy Birdクローンを作成するプロジェクトで、複数のサブエージェントが以下の問題を引き起こしました:

- タスクの誤解釈:各エージェントが異なる解釈でタスクを実行

- 視覚的不整合:異なるビジュアルスタイルの混在

- 作業の重複:他のエージェントの作業を認識できず重複実装

- 統合の失敗:最終的な成果物が機能しない

他の研究者による課題の指摘

重要な洞察

Cognition AIは、このクロスエージェントのコンテキスト伝達問題を解決するための専用の取り組みが不足していると指摘しています。彼らは、単一スレッドのエージェントが人間とのコミュニケーション能力を向上させることで、より大きな並列処理と効率性が解き放たれると信じています。

これは、まず基礎的な部分を固めることの重要性を示唆しています。

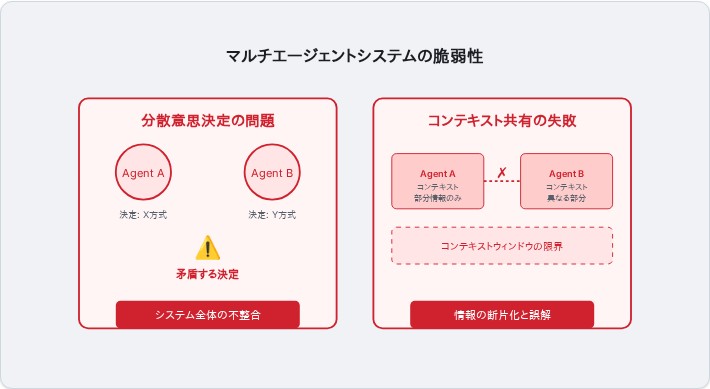

5. マルチエージェントの「脆さ」の根源:分散意思決定とコンテキスト共有の課題

マルチエージェントシステムの「脆さ」は、LLMの特性と分散システムの課題が複合的に作用した結果として現れます。これらの課題を詳細に理解することで、なぜ現在の技術水準では堅牢なマルチエージェントシステムの構築が困難なのかが明確になります。

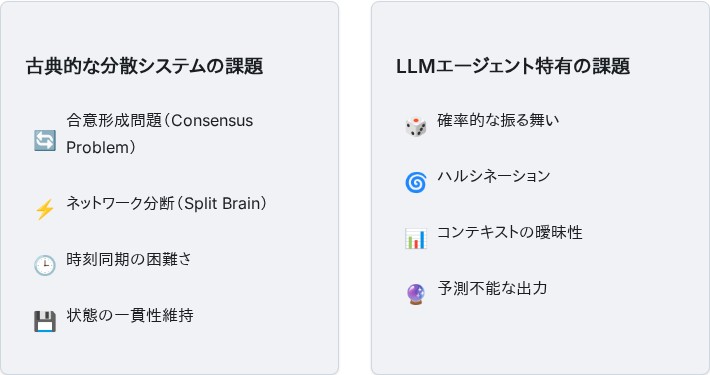

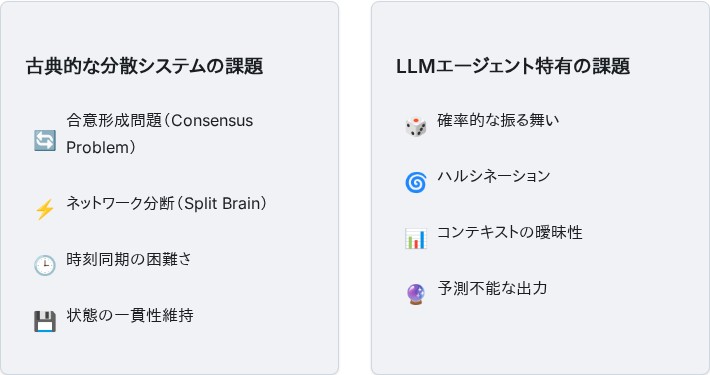

分散システムにおける意思決定の複雑さ

分散システムの本質的な課題

マルチエージェントシステムは、本質的に「分散システム」の一種です。分散システムでは、単一の制御点なしに複数のエージェントが連携し、冗長性を高め、障害リスクを低減するという理想があります。

コンテキストウィンドウの限界がもたらす影響

LLMの推論・計画能力の限界

外部ツール連携の複雑性

ツール連携における課題の増幅

外部ツールとの連携(RAGなど)は、LLMの知識範囲と精度を補完するために不可欠ですが、複数のエージェントが異なるツールを連携させ、その結果を共有する際には、さらに複雑な調整が必要となります。

例えば:

- 数学エージェント:計算ツールを使用

- 分析エージェント:データベースクエリツールを使用

- 検証エージェント:ファクトチェックAPIを使用

これらが連携する際、ツールの結果の解釈や統合において不整合が生じやすくなります。

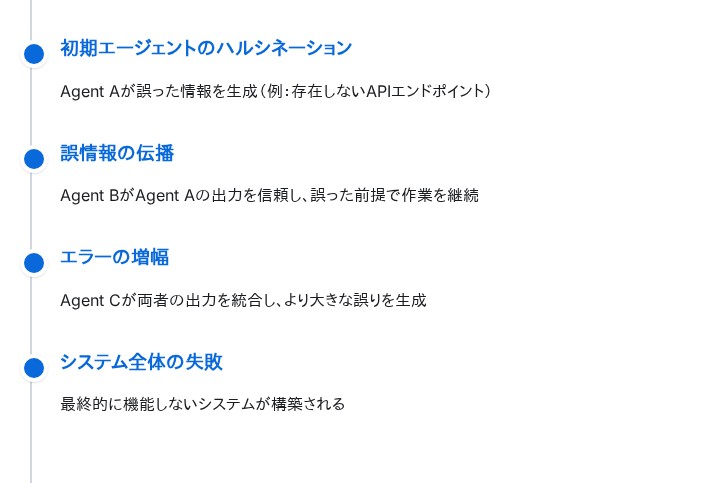

ハルシネーションの伝播リスク

重要な洞察:複合的な脆弱性

マルチエージェントの「脆さ」は、LLM固有の「コンテキストウィンドウの限界」と、一般的な「分散システムにおける一貫性とフォールトトレランスの課題」が組み合わさることで顕在化します。

LLMが持つ確率的な性質や、論理的推論の限界が、分散環境での協調をさらに困難にしています。特に、LLMの「ハルシネーション」は、分散システムにおける「誤情報」の伝播リスクを増大させ、信頼性を著しく損なう可能性があります。

6. シングルエージェントLLMとマルチエージェントLLMの比較

シングルエージェントとマルチエージェントの特性を比較することで、それぞれの強みと弱み、そして現在の技術的制約下での適切な選択が明確になります。

重要な観察

この比較表は、マルチエージェントの各項目に「(理想)」という注釈が多いことに注目してください。これは、Cognition AIの「脆さ」の主張が、マルチエージェントの理想的な利点が現在の技術では十分に実現できていないことによるものであることを示しています。

実装アプローチの変遷

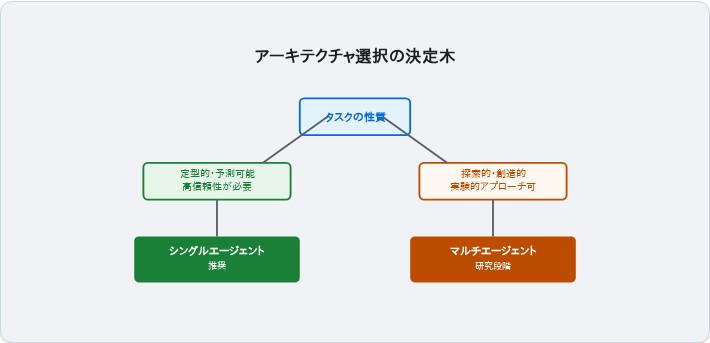

アーキテクチャ選択の指針

アーキテクチャ選択のベストプラクティス

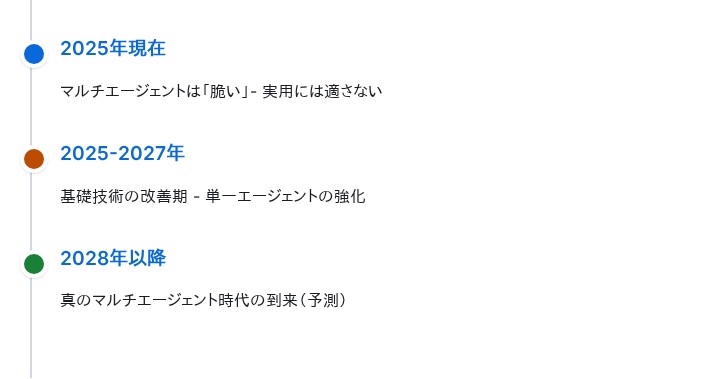

2025年現在の推奨事項:

- プロダクション環境:シングルエージェントアーキテクチャを選択

- 研究・実験環境:マルチエージェントの探索は価値がある

- ハイブリッドアプローチ:メインエージェント+限定的なサブエージェント

- 段階的移行:将来的な技術進歩に備えた設計

7. 未来への展望:より堅牢なエージェントシステムのために

現在のマルチエージェントシステムが直面する課題は大きいものの、その潜在能力は依然として高く評価されており、将来に向けた解決策の模索が活発に行われています。

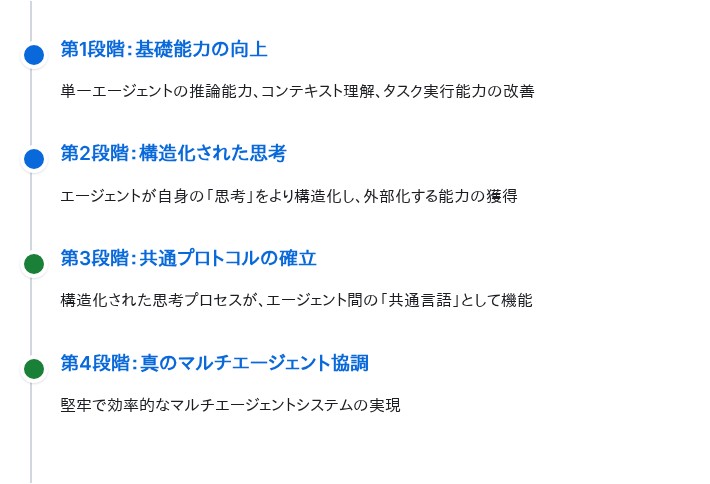

単一スレッドエージェントの進化

人間とのコミュニケーション能力向上基礎的進歩

Cognition AIは、クロスエージェントのコンテキスト伝達問題が解決されるのは、まず単一スレッドのエージェントが人間とのコミュニケーション能力を向上させた後であると予測しています。

技術的ブレークスルーの方向性

自己改善型フレームワークの台頭

SiriuSフレームワークの例

現在のマルチエージェントシステムが「脆い」のは、手動で設計されたプロンプトやヒューリスティクスに依存しているためです。SiriuSのようなフレームワークは:

- 経験ライブラリ:成功した推論の軌跡を保持

- 継続的学習:失敗から学び、成功パターンを強化

- 自己修正:エラーを検出し、自動的に修正

- 強化学習:パフォーマンスの継続的改善

分散AIシステムの基盤技術進化

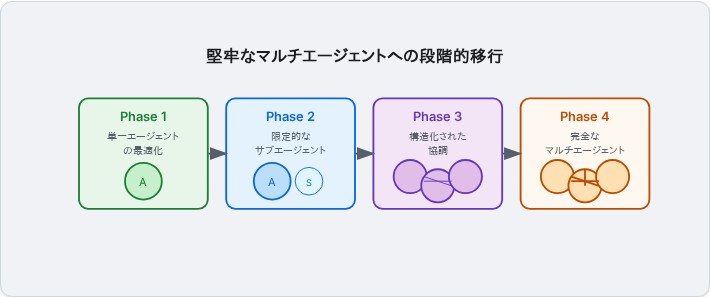

実践的な移行戦略

重要な示唆

Cognition AIが現在のマルチエージェントの「脆さ」を指摘する一方で、様々な研究が活発に行われていることは、この「脆さ」を克服するための具体的な取り組みが進行中であることを示しています。

これは、Cognition AIの「構築しない」というアドバイスが、現在の実用的なエンジニアリングの観点からのものであり、学術的な研究や長期的な可能性を否定するものではないことを意味します。

8. まとめ

現在のマルチエージェントシステムは、その潜在的な利点にもかかわらず、分散意思決定と不十分なコンテキスト共有という根本的な課題により「脆い」と見なされています。

主要な結論

実践的な推奨事項

エンジニアとプロダクトマネージャーへの提言

- 現在のプロジェクト:シングルエージェントアーキテクチャを採用し、確実な価値提供を優先

- 実験的取り組み:限定的な環境でマルチエージェントの可能性を探索

- 技術選定:Claude Codeのような実績のあるアプローチを参考に

- 将来への準備:モジュラー設計により、将来の技術進歩に対応可能な構造を維持

最終的な洞察

技術の成熟を待つ賢明さ

Cognition AIの提言は、現在の技術的制約を認識し、信頼性を優先する現実的なアプローチを促すものです。これは、安易なマルチエージェントの導入が予期せぬ問題を引き起こす可能性を警告しています。

しかし、これはマルチエージェントの可能性を否定するものではなく、むしろ単一エージェントの人間とのコミュニケーション能力の向上や、自己改善型フレームワークの研究といった基礎的な進歩が、将来的に真に堅牢で効率的なマルチエージェントシステムを解き放つ鍵となるでしょう。

私たちは、この技術の進化を注意深く見守り、基礎を固めることの重要性を忘れずに、より賢く、より信頼性の高いAIシステムの構築を目指すべきです。

“現在の課題を理解し、長期的な視点を持って研究開発を進めることが、次世代の堅牢なAIエージェントシステムを築く上で不可欠です。”